更新实战项目内容

This commit is contained in:

406

note/实战项目/基于 flink 的电商用户行为数据分析【5】基于埋点日志数据的网络流量统计.md

Normal file

406

note/实战项目/基于 flink 的电商用户行为数据分析【5】基于埋点日志数据的网络流量统计.md

Normal file

@@ -0,0 +1,406 @@

|

||||

## 前言

|

||||

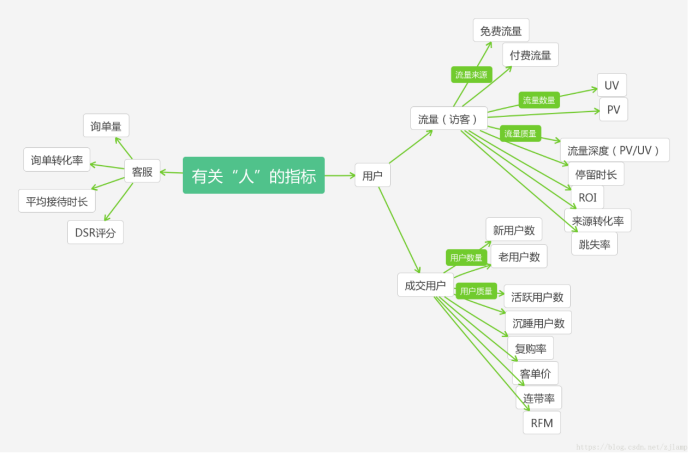

在[《基于flink的电商用户行为数据分析【3】| 实时流量统计》](https://alice.blog.csdn.net/article/details/110212749)这篇文章中,博主为大家介绍了基于服务器 log 的热门页面浏览量统计。 最后通过运行结果的验证,我们发现,从 web 服务器 log 中得到的 url,往往更多的是请求某个资源地址(`/*.js`、`/*.css`),如果要针对页面进行统计往往还需要进行过滤。而在实际电商应用中,**相比每个单独页面的访问量,我们可能更加关心整个电商网站的网络流量**。这个指标,除了合并之前每个页面的统计结果之外,还可以通过统计埋点日志数据中的“pv”行为来得到....

|

||||

|

||||

|

||||

|

||||

|

||||

***

|

||||

### 网站总浏览量(PV)的统计

|

||||

衡量网站流量一个最简单的指标,就是网站的**页面浏览量**(Page View,PV)。用户每次打开一个页面便记录1次PV,多次打开同一页面则浏览量累计。一般来说,PV与来访者的数量成正比,但是PV并不直接决定页面的真实来访者数量,如同一个来访者通过不断的刷新页面,也可以制造出非常高的PV。

|

||||

|

||||

|

||||

我们知道,用户浏览页面时,会从浏览器向网络服务器发出一个请求(Request),网络服务器接到这个请求后,会将该请求对应的一个网页(Page)发送给浏览器,从而产生了一个PV。所以我们的统计方法,可以是**从web服务器的日志中去提取对应的页面访问**然后统计,就向上一节中的做法一样;也可以**直接从埋点日志中提取用户发来的页面请求**,从而统计出总浏览量。

|

||||

|

||||

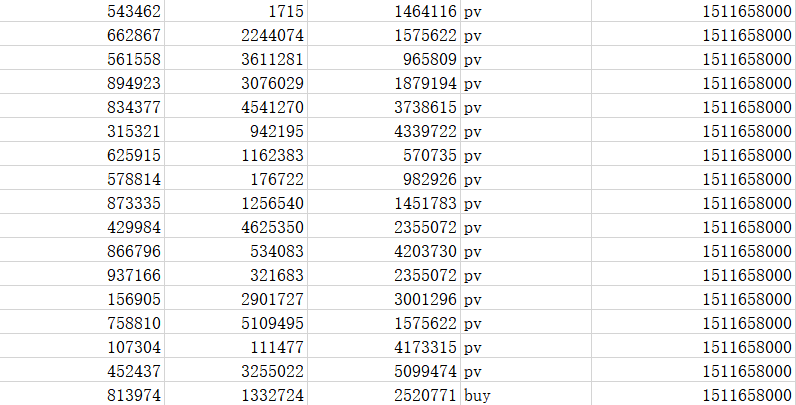

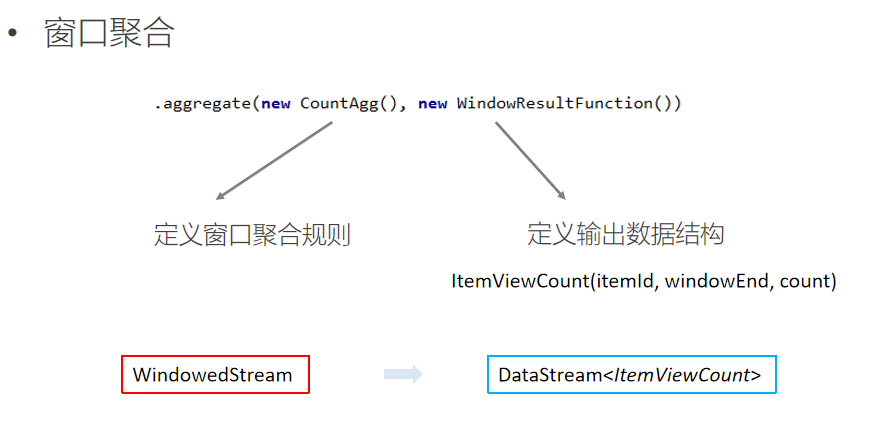

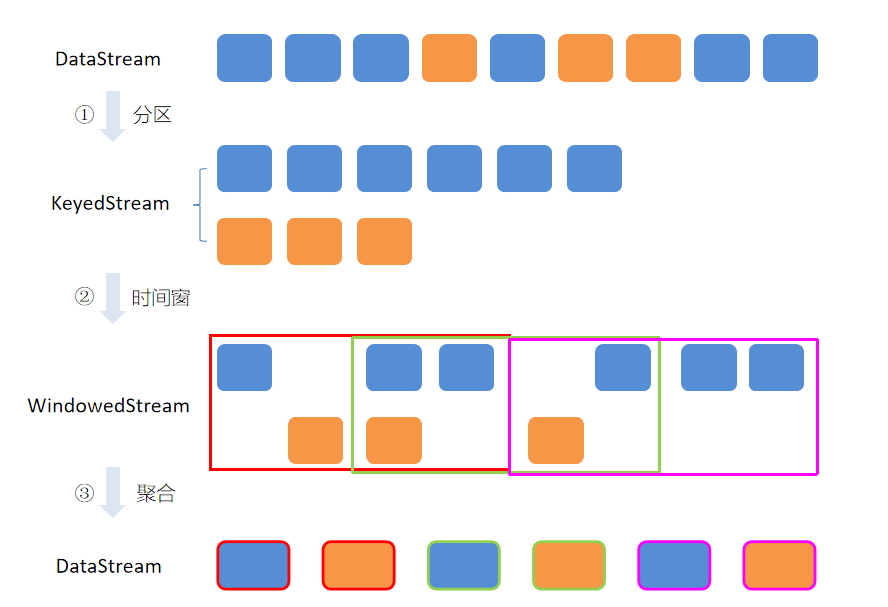

所以,接下来我们用UserBehavior.csv作为数据源,实现一个网站总浏览量的统计。我们可以设置滚动时间窗口,实时统计每小时内的网站PV。

|

||||

|

||||

|

||||

在src/main/scala下创建 `PageView.scala` 文件,具体代码如下:

|

||||

|

||||

```scala

|

||||

object PageView {

|

||||

|

||||

case class UserBehavior(userId: Long, itemId: Long, categoryId: Int, behavior: String, timestamp: Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 创建 流处理的 环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置时间语义为 eventTime -- 事件创建的时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

// 设置程序的并行度

|

||||

env.setParallelism(1)

|

||||

|

||||

// 读取文本数据

|

||||

env.readTextFile("YOUR_PATH\\UserBehavior.csv")

|

||||

// 对文本数据进行封装处理

|

||||

.map(data => {

|

||||

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

// 将数据封装进 UserBehavior

|

||||

UserBehavior(dataArray(0).toLong,dataArray(1).toLong,dataArray(2).toInt,dataArray(3),dataArray(4).toLong)

|

||||

})

|

||||

// 设置水印

|

||||

.assignAscendingTimestamps(_.timestamp * 1000)

|

||||

// 过滤出 "pv" 数据

|

||||

.filter(_.behavior == "pv")

|

||||

// 求和

|

||||

.map(x => ("pv",1))

|

||||

.keyBy(_._1)

|

||||

// 设置TimeWindow,每一小时做一次聚合

|

||||

.timeWindow(Time.seconds(60 * 60))

|

||||

.sum(1)

|

||||

.print()

|

||||

|

||||

// 执行程序

|

||||

env.execute("Page View Job")

|

||||

}

|

||||

}

|

||||

|

||||

```

|

||||

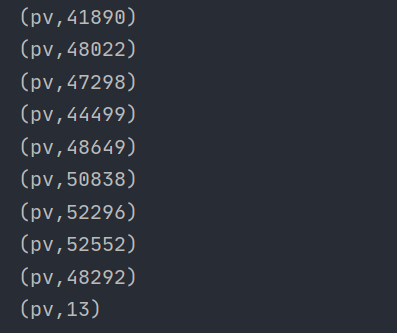

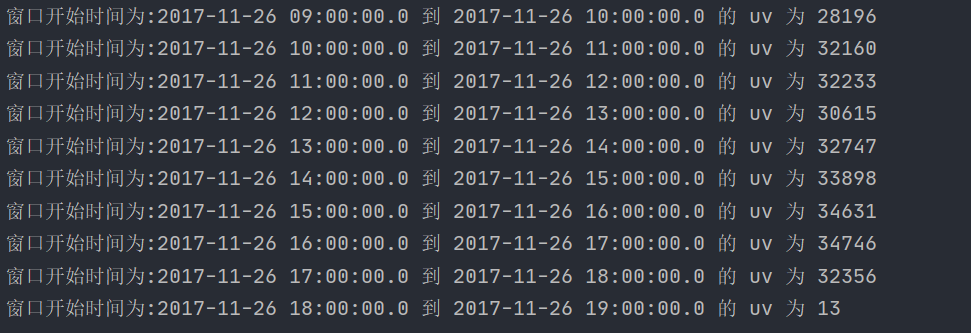

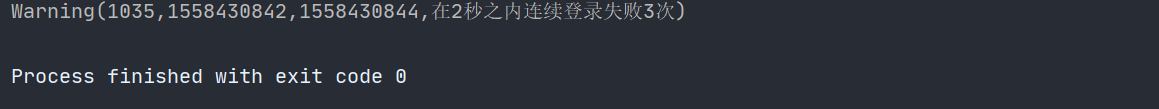

程序运行的结果:

|

||||

|

||||

|

||||

|

||||

### 网站独立访客数(UV)的统计

|

||||

在上节的例子中,我们统计的是**所有用户对页面的所有浏览行为**,也就是说,**同一用户的浏览行为会被重复统计**。而在实际应用中,我们往往还会关注,在一段时间内到底**有多少不同的用户访问了网站**。

|

||||

|

||||

另外一个统计流量的重要指标是网站的**独立访客数**(Unique Visitor,UV)。**UV指的是一段时间(比如一小时)内访问网站的总人数**,1天内同一访客的多次访问只记录为一个访客。通过`IP`和`cookie`一般是判断UV值的两种方式。<font color='gray'>当客户端第一次访问某个网站服务器的时候,网站服务器会给这个客户端的电脑发出一个Cookie,通常放在这个客户端电脑的C盘当中。在这个Cookie中会分配一个独一无二的编号,这其中会记录一些访问服务器的信息,如访问时间,访问了哪些页面等等。当你下次再访问这个服务器的时候,服务器就可以直接从你的电脑中找到上一次放进去的Cookie文件,并且对其进行一些更新,但那个独一无二的编号是不会变的。</font>

|

||||

|

||||

当然,对于UserBehavior 数据源来说,我们直接可以根据userId来区分不同的用户。

|

||||

|

||||

在src/main/scala下创建`UniqueVisitor.scala`文件,具体代码如下:

|

||||

|

||||

```scala

|

||||

object UniqueVisitor {

|

||||

|

||||

case class UserBehavior(userId: Long, itemId: Long, categoryId: Int, behavior: String, timestamp: Long)

|

||||

case class UvCount(windowEnd: Long, count: Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 创建 流处理的 环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置时间语义为 eventTime -- 事件创建的时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

// 设置程序的并行度

|

||||

env.setParallelism(1)

|

||||

|

||||

// 读取文本数据

|

||||

env.readTextFile("YOUR_PATH\\UserBehavior.csv")

|

||||

// 对文本数据进行封装处理

|

||||

.map(data => {

|

||||

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

// 将数据封装进 UserBehavior

|

||||

UserBehavior(dataArray(0).toLong,dataArray(1).toLong,dataArray(2).toInt,dataArray(3),dataArray(4).toLong)

|

||||

})

|

||||

// 设置水印

|

||||

.assignAscendingTimestamps(_.timestamp * 1000)

|

||||

// 过滤出 "pv" 数据

|

||||

.filter(_.behavior == "pv")

|

||||

// 设置窗口大小为一个小时

|

||||

.timeWindowAll(Time.seconds(60 * 60))

|

||||

.apply(new UvCountByWindow())

|

||||

.print()

|

||||

|

||||

// 执行程序

|

||||

env.execute("Page View Job")

|

||||

}

|

||||

|

||||

class UvCountByWindow extends AllWindowFunction[UserBehavior,UvCount,TimeWindow]{

|

||||

|

||||

override def apply(window: TimeWindow, input: Iterable[UserBehavior], out: Collector[UvCount]): Unit = {

|

||||

|

||||

// 初始化一个Set集合,用于将存储的用户id数据进行去重

|

||||

var idSet: Set[Long] = Set[Long]()

|

||||

|

||||

for ( userBehavior <- input){

|

||||

idSet += userBehavior.userId

|

||||

}

|

||||

|

||||

// 输出结果

|

||||

out.collect(UvCount(window.getEnd,idSet.size))

|

||||

|

||||

}

|

||||

}

|

||||

}

|

||||

```

|

||||

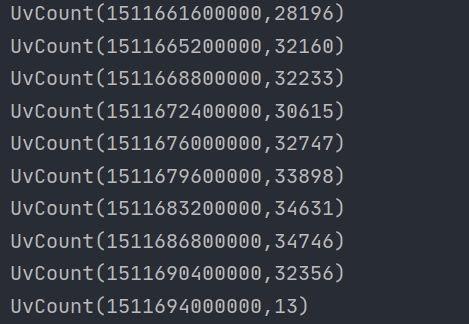

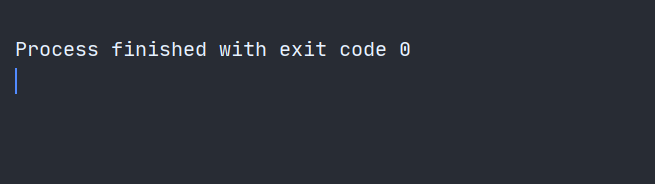

程序运行的结果:

|

||||

|

||||

|

||||

到了这一步,让我们想想,还有没有更好的方案?

|

||||

|

||||

|

||||

|

||||

|

||||

### 使用布隆过滤器的 UV 统计

|

||||

在上节的例子中,我们把所有数据的userId都存在了窗口计算的状态里,在窗口收集数据的过程中,状态会不断增大。一般情况下,只要不超出内存的承受范围,这种做法也没什么问题;但如果我们遇到的数据量很大呢?

|

||||

|

||||

把所有数据暂存放到内存里,显然不是一个好注意。我们会想到,可以利用**redis这种内存级k-v数据库**,为我们做一个缓存。但如果我们遇到的情况非常极端,数据大到惊人呢?比如上亿级的用户,要去重计算UV。

|

||||

|

||||

如果放到redis中,亿级的用户id(每个20字节左右的话)可能需要几G甚至几十G的空间来存储。当然放到redis中,用集群进行扩展也不是不可以,但明显代价太大了。

|

||||

|

||||

一个更好的想法是,其实我们不需要完整地存储用户ID的信息,只要知道他在不在就行了。所以其实我们可以进行压缩处理,用一位(bit)就可以表示一个用户的状态。这个思想的具体实现就是**布隆过滤器**`(Bloom Filter)`。

|

||||

|

||||

本质上**布隆过滤器**是一种数据结构,比较巧妙的概率型数据结构(probabilistic data structure),特点是**高效地插入和查询**,可以用来告诉你 “某样东西一定不存在或者可能存在”。

|

||||

|

||||

它本身是一个很长的二进制向量,既然是二进制的向量,那么显而易见的,存放的不是0,就是1。<font color='Tomato'>相比于传统的 List、Set、Map 等数据结构,它更高效、占用空间更少,但是缺点是其返回的结果是概率性的,而不是确切的</font>

|

||||

|

||||

我们的目标就是,利用某种方法(一般是Hash函数)把每个数据,对应到一个位图的某一位上去;如果数据存在,那一位就是1,不存在则为0。

|

||||

|

||||

接下来我们就来具体实现一下。

|

||||

|

||||

注意这里我们用到了redis连接存取数据,所以需要加入redis客户端的依赖:

|

||||

|

||||

```xml

|

||||

<dependencies>

|

||||

<dependency>

|

||||

<groupId>redis.clients</groupId>

|

||||

<artifactId>jedis</artifactId>

|

||||

<version>2.8.1</version>

|

||||

</dependency>

|

||||

</dependencies>

|

||||

```

|

||||

|

||||

在src/main/scala下创建UniqueVisitor.scala文件,具体代码如下:

|

||||

|

||||

```scala

|

||||

object UvWithBloomFilter {

|

||||

|

||||

// 定义样例类,用于封装数据

|

||||

case class UserBehavior(userId: Long, itemId: Long, categoryId: Int, behavior: String, timestamp: Long)

|

||||

|

||||

case class UvCount(windowEnd: Long, count: Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 创建 流处理的 环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置时间语义为 eventTime -- 事件创建的时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

// 设置程序的并行度

|

||||

env.setParallelism(1)

|

||||

|

||||

// 读取文本数据

|

||||

env.readTextFile("YOUR_PATH\\UserBehavior.csv")

|

||||

// 对文本数据进行封装处理

|

||||

.map(data => {

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

// 将数据封装进 UserBehavior

|

||||

UserBehavior(dataArray(0).toLong, dataArray(1).toLong, dataArray(2).toInt, dataArray(3), dataArray(4).toLong)

|

||||

})

|

||||

// 设置水印 [ 升序时间戳 ]

|

||||

.assignAscendingTimestamps(_.timestamp * 1000)

|

||||

// 只统计 "pv" 数据

|

||||

.filter(_.behavior == "pv")

|

||||

.map(data => ("dummyKey", data.userId))

|

||||

.keyBy(_._1)

|

||||

// 设置窗口大小为一个小时

|

||||

.timeWindow(Time.hours(1))

|

||||

// 我们不应该等待窗口关闭才去做 Redis 的连接 -》 数据量可能很大,窗口的内存放不下

|

||||

// 所以这里使用了 触发窗口操作的API -- 触发器 trigger

|

||||

.trigger(new MyTrigger())

|

||||

.process(new UvCountWithBloom())

|

||||

.print()

|

||||

|

||||

// 执行程序

|

||||

env.execute("uv with bloom Job")

|

||||

|

||||

}

|

||||

|

||||

// 自定义窗口触发器

|

||||

class MyTrigger() extends Trigger[(String, Long), TimeWindow] {

|

||||

// 如果事件是基于 processTime 触发

|

||||

override def onProcessingTime(time: Long, window: TimeWindow, ctx: Trigger.TriggerContext): TriggerResult = {

|

||||

|

||||

TriggerResult.CONTINUE

|

||||

}

|

||||

|

||||

// 如果事件是基于 eventTime 触发

|

||||

override def onEventTime(time: Long, window: TimeWindow, ctx: Trigger.TriggerContext): TriggerResult = {

|

||||

|

||||

|

||||

TriggerResult.CONTINUE

|

||||

}

|

||||

|

||||

// 收尾工作

|

||||

override def clear(window: TimeWindow, ctx: Trigger.TriggerContext): Unit = {}

|

||||

|

||||

// 每来一个元素就触发

|

||||

override def onElement(element: (String, Long), timestamp: Long, window: TimeWindow, ctx: Trigger.TriggerContext): TriggerResult = {

|

||||

|

||||

// 每来一条数据,就直接触发窗口操作,并清空所有窗口状态

|

||||

TriggerResult.FIRE_AND_PURGE

|

||||

}

|

||||

}

|

||||

|

||||

|

||||

// 定义一个布隆过滤器

|

||||

class Bloom(size: Long) extends Serializable {

|

||||

// 位图的总大小

|

||||

private val cap = if (size > 0) size else 1 << 27

|

||||

|

||||

// 定义 hash 函数

|

||||

def hash(value: String, seed: Int) = {

|

||||

|

||||

var result: Long = 0L

|

||||

for (i <- 0 until value.length) {

|

||||

result = result * seed + value.charAt(i)

|

||||

}

|

||||

result & (cap - 1)

|

||||

}

|

||||

}

|

||||

|

||||

// 自定义窗口处理函数

|

||||

class UvCountWithBloom() extends ProcessWindowFunction[(String, Long), UvCount, String, TimeWindow] {

|

||||

|

||||

// 创建 redis 连接

|

||||

lazy val jedis = new Jedis("node02", 6379)

|

||||

|

||||

lazy val bloom = new Bloom(1 << 29)

|

||||

|

||||

override def process(key: String, context: Context, elements: Iterable[(String, Long)], out: Collector[UvCount]): Unit = {

|

||||

// 位图的存储方式, key 是 windowEnd,value 是 bitmap

|

||||

val storeKey: String = context.window.getEnd.toString

|

||||

var count = 0L

|

||||

// 把每个窗口的 uv count 值也存入 redis 表,存放内容为(windowEnd > uvCount),所以要先从 redis 中读取

|

||||

if (jedis.hget("count", storeKey) != null) {

|

||||

count = jedis.hget("count", storeKey).toLong

|

||||

}

|

||||

|

||||

// 用 布隆过滤器 判断当前用户是否已经存在

|

||||

// 因为是每来一条数据就判断一次,所以我们就可以直接用last获取到这条数据

|

||||

val userId: String = elements.last._2.toString

|

||||

// 计算哈希

|

||||

val offset: Long = bloom.hash(userId, 61)

|

||||

// 定义一个标志位,判断 redis 位图中有没有这一位

|

||||

val isExist: lang.Boolean = jedis.getbit(storeKey, offset)

|

||||

|

||||

if (!isExist) {

|

||||

// 如果不存在,位图对应位置1,count + 1

|

||||

jedis.setbit(storeKey, offset, true)

|

||||

jedis.hset("count", storeKey, (count + 1).toString)

|

||||

out.collect(UvCount(storeKey.toLong, count + 1))

|

||||

} else {

|

||||

// 输出到 flink

|

||||

out.collect(UvCount(storeKey.toLong, count))

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

}

|

||||

```

|

||||

|

||||

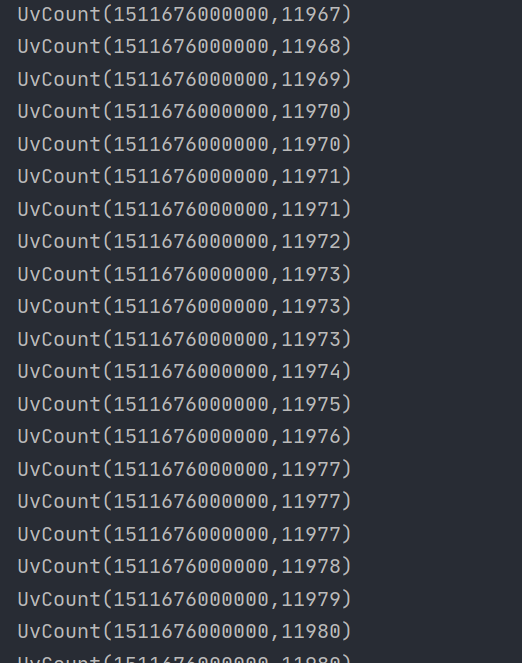

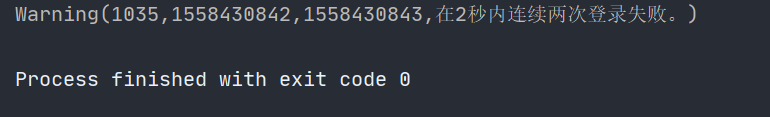

程序运行的效果如下所示:

|

||||

|

||||

可以发现,我们改进之后的程序,不再是把所有需要统计的数据都放到本地内存里进行计算,而是来一条数据,我们就输出,然后利用布隆过滤器进行判断,并将最新的结果存入Redis。

|

||||

|

||||

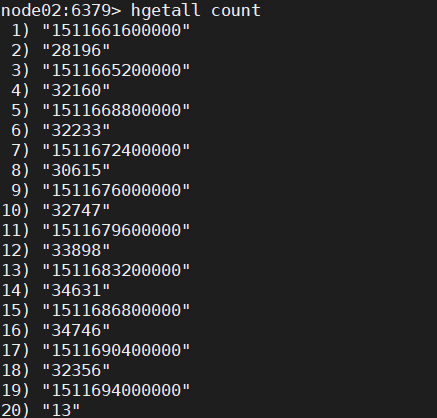

等到程序运行完毕,我们打开 `redis`,输入`hgetall count`查看统计的最终结果,可以发现跟我们之前统计的结果是一致的。

|

||||

|

||||

要是嫌利用 redis 的 `bitmap` 自己手动实现一个简单的布隆过滤器过程繁琐的话,我们也可以利用<font color='Tomato'>Flink官方实现的布隆过滤器</font>来实现。具体代码见下:

|

||||

|

||||

```scala

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/5 18:29

|

||||

* @Description:

|

||||

// uv: unique visitor

|

||||

// 有多少用户访问过网站;pv按照userid去重

|

||||

// 滑动窗口:窗口长度1小时,滑动距离5秒钟,每小时用户数量1亿

|

||||

// 大数据去重的唯一解决方案:布隆过滤器

|

||||

// 布隆过滤器的组成:bit数组,哈希函数

|

||||

*/

|

||||

object UvByBloomFilterWithoutRedis {

|

||||

|

||||

case class UserBehavior(userId: Long,

|

||||

itemId: Long,

|

||||

categoryId: Long,

|

||||

behavior: String,

|

||||

timestamp: Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

env.setParallelism(1)

|

||||

|

||||

val stream: DataStream[String] = env.readTextFile("G:\\idea arc\\BIGDATA\\project\\src\\main\\resources\\UserBehavior.csv")

|

||||

.map(line => {

|

||||

val arr: Array[String] = line.split(",")

|

||||

UserBehavior(arr(0).toLong, arr(1).toLong, arr(2).toLong, arr(3), arr(4).toLong * 1000)

|

||||

})

|

||||

.filter(_.behavior.equals("pv")) // 只处理 pv 数据

|

||||

.assignAscendingTimestamps(_.timestamp) // 分配升序时间戳

|

||||

.map(r => ("key", r.userId)) // 对每个元素做处理

|

||||

.keyBy(_._1) // 分到同一组操作

|

||||

.timeWindow(Time.hours(1)) // 设置滑动窗口时间

|

||||

.aggregate(new UvAggFunc, new UvProcessFunc) // 自定义预聚合

|

||||

|

||||

// 打印结果

|

||||

stream.print()

|

||||

// 执行任务

|

||||

env.execute()

|

||||

|

||||

}

|

||||

|

||||

// 直接用聚合算子【count,布隆过滤器】

|

||||

class UvAggFunc extends AggregateFunction[(String,Long),(Long,BloomFilter[lang.Long]),Long]{

|

||||

|

||||

override def createAccumulator(): (Long, BloomFilter[lang.Long]) = (0,BloomFilter.create(Funnels.longFunnel(), 100000000, 0.01))

|

||||

|

||||

override def add(value: (String, Long), accumulator: (Long, BloomFilter[lang.Long])): (Long, BloomFilter[lang.Long]) = {

|

||||

|

||||

var bloom: BloomFilter[lang.Long] = accumulator._2

|

||||

var uvCount: Long = accumulator._1

|

||||

|

||||

// 通过布隆过滤器判断是否存在,不存在则 +1

|

||||

if (!bloom.mightContain(value._2)){

|

||||

bloom.put(value._2)

|

||||

uvCount += 1

|

||||

}

|

||||

(uvCount,bloom)

|

||||

}

|

||||

|

||||

override def getResult(accumulator: (Long, BloomFilter[lang.Long])): Long = accumulator._1 // 返回 count

|

||||

|

||||

override def merge(a: (Long, BloomFilter[lang.Long]), b: (Long, BloomFilter[lang.Long])): (Long, BloomFilter[lang.Long]) = ???

|

||||

|

||||

}

|

||||

|

||||

class UvProcessFunc extends ProcessWindowFunction[Long,String,String,TimeWindow]{

|

||||

|

||||

override def process(key: String, context: Context, elements: Iterable[Long], out: Collector[String]): Unit = {

|

||||

|

||||

// 拿到 Windows 的开始和结束时间

|

||||

val start: Timestamp = new Timestamp(context.window.getStart)

|

||||

val end: Timestamp = new Timestamp(context.window.getEnd)

|

||||

out.collect(s"窗口开始时间为:$start 到 $end 的 uv 为 ${elements.head}")

|

||||

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

```

|

||||

|

||||

程序的运行结果:

|

||||

|

||||

***

|

||||

|

||||

### 小结

|

||||

本期文章,为大家讲解了**在基于flink的电商用户行为数据分析的项目中,如何基于埋点日志数据实现网络流量统计的功能**。一共介绍了3种不同的实现方式,其中光统计 UV 就有3种解决方案!文章中已将完整代码贴出,对代码有任何疑问的小伙伴均可加我微信私聊,交流学习!你知道的越多,你不知道的也越多,我是Alice,我们下一期见!

|

||||

|

||||

**受益的朋友记得三连支持小菌!**

|

||||

|

||||

|

||||

>**文章持续更新,可以微信搜一搜「 猿人菌 」第一时间阅读,思维导图,大数据书籍,大数据高频面试题,海量一线大厂面经…期待您的关注!**

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

336

note/实战项目/基于 flink 的电商用户行为数据分析【6】APP市场推广统计.md

Normal file

336

note/实战项目/基于 flink 的电商用户行为数据分析【6】APP市场推广统计.md

Normal file

@@ -0,0 +1,336 @@

|

||||

## 前言

|

||||

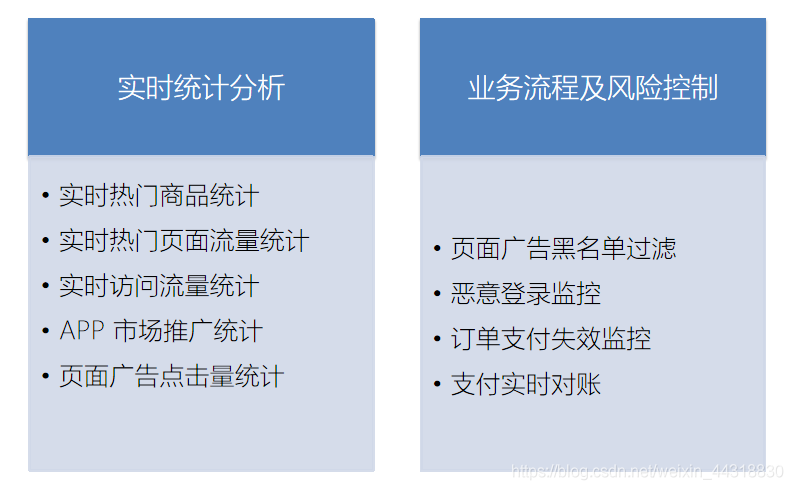

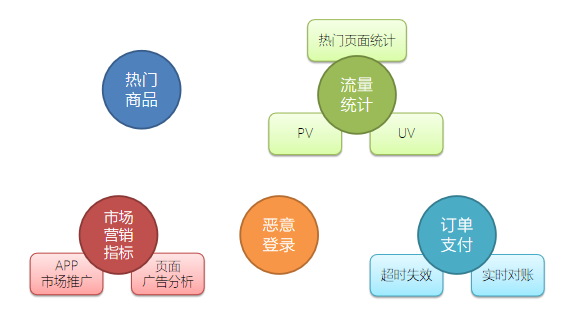

本篇是flink 的「电商用户行为数据分析」的第6篇文章,为大家带来的是**市场营销商业指标统计分析**之**APP市场推广统计**的内容,通过本期内容的学习,你同样能够学会处理一些特定场景领域下的方法。话不多说,我们直入正题!

|

||||

|

||||

|

||||

***

|

||||

## 模块创建和数据准备

|

||||

继续在`UserBehaviorAnalysis`下新建一个**maven module**作为子项目,命名为`MarketAnalysis`。

|

||||

|

||||

这个模块中我们没有现成的数据,所以会用自定义的测试源来产生测试数据流,或者直接用生成测试数据文件。

|

||||

|

||||

## APP市场推广统计

|

||||

随着智能手机的普及,在如今的电商网站中已经有越来越多的用户来自移动端,相比起传统浏览器的登录方式,手机APP成为了更多用户访问电商网站的首选。**对于电商企业来说,一般会通过各种不同的渠道对自己的APP进行市场推广,而这些渠道的统计数据(比如,不同网站上广告链接的点击量、APP下载量)就成了市场营销的重要商业指标**。

|

||||

|

||||

首先我们考察分渠道的市场推广统计。在src/main/scala下创建`AppMarketingByChannel.scala`文件。由于没有现成的数据,所以我们需要**自定义一个测试源**来生成用户行为的事件流。

|

||||

|

||||

## 自定义测试数据源

|

||||

定义一个源数据的样例类`MarketingUserBehavior`,再定义一个`SourceFunction`,用于产生用户行为源数据,命名为`SimulatedEventSource`:

|

||||

|

||||

```scala

|

||||

// 定义一个输入数据的样例类 保存电商用户行为的样例类

|

||||

case class MarketingUserBehavior(userId: String, behavior: String, channel: String, timestamp: Long)

|

||||

|

||||

// 定义一个输出结果的样例类 保存 市场用户点击次数

|

||||

case class MarketingViewCount(windowStart: String, windowEnd: String, channel: String, behavior: String, count: Long)

|

||||

|

||||

// 自定义数据源

|

||||

class SimulateEventSource extends RichParallelSourceFunction[MarketingUserBehavior] {

|

||||

|

||||

// 定义是否运行的标识符

|

||||

var running: Boolean = true

|

||||

// 定义渠道的集合

|

||||

val channelSet: Seq[String] = Seq("AppStore", "XiaomiStore", "HuaweiStore", "weibo", "wechat", "tieba")

|

||||

// 定义用户行为的集合

|

||||

val behaviorTypes: Seq[String] = Seq("BROWSE", "CLICK", "PURCHASE", "UNINSTALL")

|

||||

// 定义随机数发生器

|

||||

val rand: Random.type = Random

|

||||

|

||||

// 重写 run 方法

|

||||

override def run(ctx: SourceFunction.SourceContext[MarketingUserBehavior]): Unit = {

|

||||

|

||||

// 获取到 Long类型的最大值

|

||||

val maxElements: Long = Long.MaxValue

|

||||

// 设置初始值

|

||||

var count: Long = 0L

|

||||

|

||||

// 随机生成所有数据

|

||||

while (running && count < maxElements) {

|

||||

|

||||

// 生成一个随机数

|

||||

val id: String = UUID.randomUUID().toString

|

||||

// 获取随机行为

|

||||

val behaviorType: String = behaviorTypes(rand.nextInt(behaviorTypes.size))

|

||||

// 获取随机渠道

|

||||

val channel: String = channelSet(rand.nextInt(channelSet.size))

|

||||

// 获取到当前的系统时间

|

||||

val ts: Long = System.currentTimeMillis()

|

||||

// 输出生成的用户行为的事件流

|

||||

ctx.collect(MarketingUserBehavior(id, behaviorType, channel, ts))

|

||||

// count + 1

|

||||

count += 1

|

||||

// 设置休眠的时间

|

||||

TimeUnit.MICROSECONDS.sleep(10L)

|

||||

|

||||

}

|

||||

}

|

||||

|

||||

override def cancel(): Unit = running = false

|

||||

}

|

||||

```

|

||||

|

||||

## 分渠道统计

|

||||

另外定义一个窗口处理的输出结果样例类 `MarketingViewCount`,并自定义 `ProcessWindowFunction`进行处理,完整代码如下:

|

||||

|

||||

```scala

|

||||

import java.sql.Timestamp

|

||||

import java.util.UUID

|

||||

import java.util.concurrent.TimeUnit

|

||||

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.source.{RichParallelSourceFunction, SourceFunction}

|

||||

import org.apache.flink.streaming.api.scala.function.ProcessWindowFunction

|

||||

import org.apache.flink.streaming.api.scala.{StreamExecutionEnvironment, _}

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.streaming.api.windowing.windows.TimeWindow

|

||||

import org.apache.flink.util.Collector

|

||||

|

||||

import scala.util.Random

|

||||

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/7 17:32

|

||||

* @Description:

|

||||

电商用户行为数据分析: 市场营销商业指标统计分析

|

||||

APP市场推广统计 - - > 分渠道统计

|

||||

*/

|

||||

object AppMarketingByChannel {

|

||||

|

||||

// 定义一个输入数据的样例类 保存电商用户行为的样例类

|

||||

case class MarketingUserBehavior(userId: String, behavior: String, channel: String, timestamp: Long)

|

||||

|

||||

// 定义一个输出结果的样例类 保存 市场用户点击次数

|

||||

case class MarketingViewCount(windowStart: String, windowEnd: String, channel: String, behavior: String, count: Long)

|

||||

|

||||

// 自定义数据源

|

||||

class SimulateEventSource extends RichParallelSourceFunction[MarketingUserBehavior] {

|

||||

|

||||

// 定义是否运行的标识符

|

||||

var running: Boolean = true

|

||||

// 定义渠道的集合

|

||||

val channelSet: Seq[String] = Seq("AppStore", "XiaomiStore", "HuaweiStore", "weibo", "wechat", "tieba")

|

||||

// 定义用户行为的集合

|

||||

val behaviorTypes: Seq[String] = Seq("BROWSE", "CLICK", "PURCHASE", "UNINSTALL")

|

||||

// 定义随机数发生器

|

||||

val rand: Random.type = Random

|

||||

|

||||

// 重写 run 方法

|

||||

override def run(ctx: SourceFunction.SourceContext[MarketingUserBehavior]): Unit = {

|

||||

|

||||

// 获取到 Long类型的最大值

|

||||

val maxElements: Long = Long.MaxValue

|

||||

// 设置初始值

|

||||

var count: Long = 0L

|

||||

|

||||

// 随机生成所有数据

|

||||

while (running && count < maxElements) {

|

||||

|

||||

// 生成一个随机数

|

||||

val id: String = UUID.randomUUID().toString

|

||||

// 获取随机行为

|

||||

val behaviorType: String = behaviorTypes(rand.nextInt(behaviorTypes.size))

|

||||

// 获取随机渠道

|

||||

val channel: String = channelSet(rand.nextInt(channelSet.size))

|

||||

// 获取到当前的系统时间

|

||||

val ts: Long = System.currentTimeMillis()

|

||||

// 输出生成的用户行为的事件流

|

||||

ctx.collect(MarketingUserBehavior(id, behaviorType, channel, ts))

|

||||

// count + 1

|

||||

count += 1

|

||||

// 设置休眠的时间

|

||||

TimeUnit.MICROSECONDS.sleep(10L)

|

||||

|

||||

}

|

||||

}

|

||||

|

||||

override def cancel(): Unit = running = false

|

||||

}

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 创建流处理的环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

|

||||

env.addSource(new SimulateEventSource()) // 添加数据源

|

||||

.assignAscendingTimestamps(_.timestamp) // 设置水印

|

||||

.filter(_.behavior != "UNINSTALL") // 过滤掉 卸载 的数据

|

||||

.map(data => {

|

||||

((data.channel, data.behavior), 1L)

|

||||

})

|

||||

.keyBy(_._1) //以渠道和行为作为key分组

|

||||

.timeWindow(Time.hours(1), Time.seconds(1)) // 设置滑动窗口,窗口大小为1h,滑动距离为1s

|

||||

.process(new MarketingCountByChannel) // 调用自定义处理方法

|

||||

.print() // 输出结果

|

||||

|

||||

// 执行程序

|

||||

env.execute("app marketing by channel job")

|

||||

|

||||

}

|

||||

|

||||

// 自定义处理函数

|

||||

class MarketingCountByChannel() extends ProcessWindowFunction[((String, String), Long), MarketingViewCount, (String, String), TimeWindow] {

|

||||

|

||||

override def process(key: (String, String), context: Context, elements: Iterable[((String, String), Long)], out: Collector[MarketingViewCount]): Unit = {

|

||||

|

||||

// 根据 context 对象分别获取到 Long 类型的 窗口的开始和结束时间

|

||||

//context.window.getStart是长整形 所以new 一个 变成String类型

|

||||

val startTs: String = new Timestamp(context.window.getStart).toString

|

||||

val endTs: String = new Timestamp(context.window.getEnd).toString

|

||||

|

||||

// 获取到 渠道

|

||||

val channel: String = key._1

|

||||

// 获取到 行为

|

||||

val behaviorType: String = key._2

|

||||

// 获取到 次数

|

||||

val count: Int = elements.size

|

||||

|

||||

// 输出结果

|

||||

out.collect(MarketingViewCount(startTs, endTs, channel, behaviorType, count))

|

||||

}

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

### 运行效果

|

||||

|

||||

|

||||

|

||||

## 不分渠道(总量)统计

|

||||

同样我们还可以考察不分渠道的市场推广统计,这样得到的就是所有渠道推广的**总量**。在src/main/scala下创建`AppMarketingStatistics.scala`文件,代码如下:

|

||||

|

||||

```scala

|

||||

import java.sql.Timestamp

|

||||

import java.util.UUID

|

||||

import java.util.concurrent.TimeUnit

|

||||

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.source.{RichParallelSourceFunction, SourceFunction}

|

||||

import org.apache.flink.streaming.api.scala.function.ProcessWindowFunction

|

||||

import org.apache.flink.streaming.api.scala.{StreamExecutionEnvironment, _}

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.streaming.api.windowing.windows.TimeWindow

|

||||

import org.apache.flink.util.Collector

|

||||

|

||||

import scala.util.Random

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/10 22:45

|

||||

* @Description:

|

||||

电商用户行为数据分析: 市场营销商业指标统计分析

|

||||

APP市场推广统计 - - > 不分渠道(总量)统计

|

||||

*/

|

||||

object AppMarketingStatistics {

|

||||

|

||||

// 定义一个输入数据的样例类 保存电商用户行为的样例类

|

||||

case class MarketingUserBehavior(userId: String, behavior: String, channel: String, timestamp: Long)

|

||||

|

||||

// 定义一个输出结果的样例类 保存 市场用户点击次数

|

||||

case class MarketingViewCount(windowStart: String, windowEnd: String, count: Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 定义流处理环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

|

||||

env.addSource(new SimulateEventSource) // 添加数据源

|

||||

.assignAscendingTimestamps(_.timestamp)

|

||||

.filter(_.behavior != "UNINSTALL")

|

||||

.map(data => {

|

||||

("key",1L) // 因为这里我们不分渠道,所以我们就将key值固定,将所有数据放入到同一个组

|

||||

})

|

||||

.keyBy(_._1)

|

||||

.timeWindow(Time.hours(1),Time.seconds(1)) // 设置滑动窗口,窗口大小为1h,滑动距离为1s

|

||||

.process(new MarketingCountByChannel) // 调用自定义处理方法

|

||||

.print() // 输出结果

|

||||

|

||||

// 执行程序

|

||||

env.execute("app marketing by channel job")

|

||||

|

||||

}

|

||||

|

||||

|

||||

// 自定义数据源

|

||||

class SimulateEventSource extends RichParallelSourceFunction[MarketingUserBehavior] {

|

||||

|

||||

// 定义是否运行的标识符

|

||||

var running: Boolean = true

|

||||

// 定义渠道的集合

|

||||

val channelSet: Seq[String] = Seq("AppStore", "XiaomiStore", "HuaweiStore", "weibo", "wechat", "tieba")

|

||||

// 定义用户行为的集合

|

||||

val behaviorTypes: Seq[String] = Seq("BROWSE", "CLICK", "PURCHASE", "UNINSTALL")

|

||||

// 定义随机数发生器

|

||||

val rand: Random.type = Random

|

||||

|

||||

// 重写 run 方法

|

||||

override def run(ctx: SourceFunction.SourceContext[MarketingUserBehavior]): Unit = {

|

||||

|

||||

// 获取到 Long类型的最大值

|

||||

val maxElements: Long = Long.MaxValue

|

||||

// 设置初始值

|

||||

var count: Long = 0L

|

||||

|

||||

// 随机生成所有数据

|

||||

while (running && count < maxElements) {

|

||||

// 生成一个随机数

|

||||

val id: String = UUID.randomUUID().toString

|

||||

// 获取随机行为

|

||||

val behaviorType: String = behaviorTypes(rand.nextInt(behaviorTypes.size))

|

||||

// 获取随机渠道

|

||||

val channel: String = channelSet(rand.nextInt(channelSet.size))

|

||||

// 获取到当前的系统时间

|

||||

val ts: Long = System.currentTimeMillis()

|

||||

// 输出生成的用户行为的事件流

|

||||

ctx.collect(MarketingUserBehavior(id, behaviorType, channel, ts))

|

||||

// count + 1

|

||||

count += 1

|

||||

// 设置休眠的时间

|

||||

TimeUnit.MICROSECONDS.sleep(10L)

|

||||

|

||||

}

|

||||

}

|

||||

|

||||

override def cancel(): Unit = running = false

|

||||

}

|

||||

|

||||

|

||||

// 自定义处理函数

|

||||

class MarketingCountByChannel() extends ProcessWindowFunction[(String, Long), MarketingViewCount, String, TimeWindow] {

|

||||

|

||||

override def process(key: String, context: Context, elements: Iterable[(String, Long)], out: Collector[MarketingViewCount]): Unit = {

|

||||

|

||||

// 根据 context 对象分别获取到 Long 类型的 窗口的开始和结束时间

|

||||

//context.window.getStart是长整形 所以new 一个 变成String类型

|

||||

val startTs: String = new Timestamp(context.window.getStart).toString

|

||||

val endTs: String = new Timestamp(context.window.getEnd).toString

|

||||

|

||||

// 获取到 次数

|

||||

val count: Int = elements.size

|

||||

|

||||

// 输出结果

|

||||

out.collect(MarketingViewCount(startTs, endTs,count))

|

||||

|

||||

}

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

### 运行效果

|

||||

|

||||

|

||||

***

|

||||

## 小结

|

||||

本期关于介绍flink 电商用户行为数据分析之**APP市场推广统计**的文章就到这里,主要为大家介绍了在自定义数据源的基础上,如何分渠道和不分渠道计算APP市场推广的数据 。考虑到部分小伙伴对于中间的部分代码有疑问,所以我每行都写上了注释,因此详细的过程笔者就不在这里详细赘述了。看了注释仍有疑惑的小伙伴们欢迎添加我的个人微信询问,互相学习,共同进步!**你知道的越多,你不知道的也越多**,我是Alice,我们下一期见!

|

||||

|

||||

**受益的朋友记得三连支持小菌!**

|

||||

|

||||

|

||||

>**文章持续更新,可以微信搜一搜「 猿人菌 」第一时间阅读,思维导图,大数据书籍,大数据高频面试题,海量一线大厂面经…期待您的关注!**

|

||||

|

||||

|

||||

242

note/实战项目/基于 flink 的电商用户行为数据分析【7】页面广告分析.md

Normal file

242

note/实战项目/基于 flink 的电商用户行为数据分析【7】页面广告分析.md

Normal file

@@ -0,0 +1,242 @@

|

||||

本篇是flink 的「电商用户行为数据分析」的第 7 篇文章,为大家带来的是**市场营销商业指标统计分析**之**页面广告分析**的内容。通过本期内容,我们可以实现**页面广告点击量统计**和**黑名单过滤**的功能。

|

||||

|

||||

|

||||

|

||||

***

|

||||

|

||||

## 页面广告分析

|

||||

电商网站的市场营销商业指标中,除了自身的APP推广,还会考虑到页面上的广告投放(包括自己经营的产品和其它网站的广告)。所以**广告相关的统计分析,也是市场营销的重要指标**。

|

||||

|

||||

对于广告的统计,最简单也最重要的就是页面广告的点击量,<font color='Tomato'>**网站往往需要根据广告点击量来制定定价策略和调整推广方式,而且也可以借此收集用户的偏好信息**</font>。更加具体的应用是,我**们可以根据用户的地理位置进行划分,从而总结出不同省份用户对不同广告的偏好,这样更有助于广告的精准投放**。

|

||||

|

||||

|

||||

## 页面广告点击量统计

|

||||

接下来我们就进行页面广告按照省份划分的点击量的统计。在src/main/scala下创建`AdStatisticsByGeo.scala`文件。同样由于没有现成的数据,我们定义一些测试数据,放在AdClickLog.csv中,用来生成用户点击广告行为的事件流。

|

||||

|

||||

|

||||

|

||||

|

||||

在代码中我们首先定义源数据的样例类`AdClickLog`,以及输出统计数据的样例类`CountByProvince`。主函数中先以 province 进行 keyBy ,然后开一小时的时间窗口,滑动距离为5秒,统计窗口内的点击事件数量。具体代码实现如下:

|

||||

|

||||

```scala

|

||||

import java.sql.Timestamp

|

||||

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.scala._

|

||||

import org.apache.flink.streaming.api.scala.function.ProcessWindowFunction

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.streaming.api.windowing.windows.TimeWindow

|

||||

import org.apache.flink.util.Collector

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/11 10:52

|

||||

* @Description:

|

||||

页面广告点击量统计 (开一小时的时间窗口,滑动距离为5秒)

|

||||

*/

|

||||

object AdStatisticsByGeo {

|

||||

|

||||

// 定义输入数据样例类

|

||||

case class AdClickEvent(userId:Long,adId:Long,province:String,city:String,timestamp:Long)

|

||||

// 定义输出数据样例类

|

||||

case class AdCountByProvince(province:String,windowEnd:String,count:Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 设置流处理的环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置程序的并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

|

||||

env.readTextFile("YOUR_PATH\\AdClickLog.csv")

|

||||

.map(data => {

|

||||

// 样例数据:561558,3611281,guangdong,shenzhen,1511658120

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

AdClickEvent(dataArray(0).toLong,dataArray(1).toLong,dataArray(2),dataArray(3),dataArray(4).toLong)

|

||||

})

|

||||

.assignAscendingTimestamps(_.timestamp * 1000L) // 添加水印

|

||||

.keyBy(_.province) // 按照 province 分组

|

||||

.timeWindow(Time.hours(1),Time.seconds(5)) // 设置窗口的大小为1h,滑动距离为5s

|

||||

.process(new AdCount) // 开窗聚合统计

|

||||

.print() // 输 出 结 果

|

||||

|

||||

// 执行程序

|

||||

env.execute("ad analysis job")

|

||||

|

||||

}

|

||||

|

||||

class AdCount() extends ProcessWindowFunction[AdClickEvent,AdCountByProvince,String,TimeWindow]{

|

||||

|

||||

override def process(key: String, context: Context, elements: Iterable[AdClickEvent], out: Collector[AdCountByProvince]): Unit = {

|

||||

|

||||

// 因为我们是按照 province 进行分组

|

||||

// 所以这里直接根据 key 就能获取到 province

|

||||

val province: String = key

|

||||

// 将 窗口结束的时间戳 转换为 String 时间字符串

|

||||

val windowEnd: String = new Timestamp(context.window.getEnd).toString

|

||||

// 获取窗口元素的个数

|

||||

val count: Int = elements.size

|

||||

// 输出元素

|

||||

out.collect(AdCountByProvince(province,windowEnd,count))

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

```

|

||||

|

||||

### 运行结果

|

||||

|

||||

|

||||

|

||||

## 黑名单过滤

|

||||

上节我们进行的点击量统计,**同一用户的重复点击是会叠加计算的**。在实际场景中,同一用户确实可能反复点开同一个广告,这也说明了用户对广告更大的兴趣;**但是如果用户在一段时间非常频繁地点击广告,这显然不是一个正常行为,有刷点击量的嫌疑**。所以我们可以对一段时间内(比如一天内)的用户点击行为进行**约束**,**如果对同一个广告点击超过一定限额(比如100次),应该把该用户加入黑名单并报警,此后其点击行为不应该再统计**。

|

||||

|

||||

|

||||

具体代码实现如下:

|

||||

|

||||

|

||||

```scala

|

||||

import java.sql.Timestamp

|

||||

|

||||

import org.apache.flink.api.common.functions.AggregateFunction

|

||||

import org.apache.flink.api.common.state.{ValueState, ValueStateDescriptor}

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.KeyedProcessFunction

|

||||

import org.apache.flink.streaming.api.scala._

|

||||

import org.apache.flink.streaming.api.scala.function.WindowFunction

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.streaming.api.windowing.windows.TimeWindow

|

||||

import org.apache.flink.util.Collector

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/11 11:37

|

||||

* @Description:

|

||||

黑名单过滤

|

||||

*/

|

||||

object AdAnalysisByProvinceBlack {

|

||||

|

||||

// 定义输入输出样例类

|

||||

case class AdClickEvent(userId:Long,adId:Long,province:String,city:String,timestamp:Long)

|

||||

case class AdCountByProvince(province:String,windowEnd:String,count:Long)

|

||||

|

||||

//定义侧输出流报警信息样例类

|

||||

case class BlackListWarning(userId:Long,adId:Long,msg:String)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 定义流处理环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

|

||||

val adLogStream: DataStream[AdClickEvent] = env.readTextFile("YOUR_PATH\\AdClickLog.csv")

|

||||

.map(data => {

|

||||

// 样例数据:561558,3611281,guangdong,shenzhen,1511658120

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

AdClickEvent(dataArray(0).toLong, dataArray(1).toLong, dataArray(2), dataArray(3), dataArray(4).toLong)

|

||||

})

|

||||

.assignAscendingTimestamps(_.timestamp * 1000L ) // 设置水印

|

||||

|

||||

//定义刷单行为 过滤操作

|

||||

val filterBlackListStream: DataStream[AdClickEvent] = adLogStream // 设置水印

|

||||

.keyBy(data =>(data.userId, data.adId)) // 按照用户 和 广告id进行分组)

|

||||

.process(new FilterBlackList(100L))

|

||||

|

||||

// 按照 province分组开窗聚合统计

|

||||

val adCountStream: DataStream[AdCountByProvince] = filterBlackListStream

|

||||

.keyBy(_.province)

|

||||

.timeWindow(Time.hours(1), Time.seconds(5)) // 设置窗口大小为1h , 滑动距离为5s

|

||||

.aggregate(new AdCountAgg(), new AdCountResult())

|

||||

|

||||

// 打印结果

|

||||

adCountStream.print()

|

||||

// 打印测输出流的数据

|

||||

filterBlackListStream.getSideOutput(new OutputTag[BlackListWarning]("blacklist")).print("blacklist")

|

||||

|

||||

// 执行程序

|

||||

env.execute("as analysis job")

|

||||

|

||||

}

|

||||

|

||||

// 实现自定义 ProcessFunction

|

||||

class FilterBlackList(maxClickCount:Long) extends KeyedProcessFunction[(Long,Long),AdClickEvent,AdClickEvent]{

|

||||

|

||||

// 定义一个状态,需要保存当前用户对当前广告的点击量 count

|

||||

lazy val countState:ValueState[Long] = getRuntimeContext.getState(new ValueStateDescriptor[Long]("count",classOf[Long]))

|

||||

// 定义一个标识位,用来表示用户是否已经在黑名单中

|

||||

lazy val isSendState:ValueState[Boolean] = getRuntimeContext.getState(new ValueStateDescriptor[Boolean]("is-sent",classOf[Boolean]))

|

||||

|

||||

override def processElement(value: AdClickEvent, ctx: KeyedProcessFunction[(Long, Long), AdClickEvent, AdClickEvent]#Context, out: Collector[AdClickEvent]): Unit = {

|

||||

// 取出状态数据

|

||||

val curCount: Long = countState.value()

|

||||

|

||||

// 如果是第一个数据,那么注册第二天0点的定时器,用于清空状态

|

||||

if (curCount == 0){

|

||||

val ts: Long = (ctx.timerService().currentProcessingTime() / (1000*60*60*24) + 1) * (1000*60*60*24)

|

||||

ctx.timerService().registerProcessingTimeTimer(ts)

|

||||

}

|

||||

// 判断 count 值是否达到上限,如果达到,并且之前没有输出过报警信息,那么则报警

|

||||

if (curCount > maxClickCount){

|

||||

if (!isSendState.value()){

|

||||

// 侧输出数据

|

||||

ctx.output(new OutputTag[BlackListWarning]("blacklist"),BlackListWarning(value.userId,value.adId,"click over"+maxClickCount+"times today"))

|

||||

// 更新黑名单状态

|

||||

isSendState.update(true)

|

||||

}

|

||||

// 如果达到上限,则不再进行后续的操作,即此后其点击行为不应该再统计

|

||||

return

|

||||

}

|

||||

|

||||

// count 值 + 1

|

||||

countState.update(curCount + 1)

|

||||

// 输出数据

|

||||

out.collect(value)

|

||||

|

||||

}

|

||||

|

||||

// 0 点触发定时器,直接清空状态

|

||||

override def onTimer(timestamp: Long, ctx: KeyedProcessFunction[(Long, Long), AdClickEvent, AdClickEvent]#OnTimerContext, out: Collector[AdClickEvent]): Unit = {

|

||||

countState.clear()

|

||||

isSendState.clear()

|

||||

}

|

||||

}

|

||||

|

||||

// 自定义预聚合函数

|

||||

class AdCountAgg() extends AggregateFunction[AdClickEvent,Long,Long]{

|

||||

override def createAccumulator(): Long = 0L

|

||||

|

||||

override def add(value: AdClickEvent, accumulator: Long): Long = accumulator + 1

|

||||

|

||||

override def getResult(accumulator: Long): Long = accumulator

|

||||

|

||||

override def merge(a: Long, b: Long): Long = a + b

|

||||

}

|

||||

|

||||

// 自定义窗口函数,第一个参数就是预聚合函数最后输出的值,Long

|

||||

class AdCountResult() extends WindowFunction[Long,AdCountByProvince,String,TimeWindow]{

|

||||

|

||||

override def apply(key: String, window: TimeWindow, input: Iterable[Long], out: Collector[AdCountByProvince]): Unit = {

|

||||

|

||||

out.collect(AdCountByProvince(key,new Timestamp(window.getEnd).toString,input.head))

|

||||

}

|

||||

}

|

||||

|

||||

}

|

||||

```

|

||||

### 运行结果

|

||||

|

||||

***

|

||||

## 小结

|

||||

|

||||

本期关于介绍**flink 电商用户行为数据分析**之**页面广告分析**的文章就到这里,考虑到部分小伙伴对于中间的部分代码有疑问,所以我每行都写上了注释,因此详细的过程笔者就不在这里详细赘述了。看了注释仍有疑惑的小伙伴们欢迎添加我的个人微信询问,**互相学习,共同进步**!**你知道的越多,你不知道的也越多**,我是Alice,我们下一期见!

|

||||

|

||||

**受益的朋友记得三连支持小菌!**

|

||||

|

||||

|

||||

>**文章持续更新,可以微信搜一搜「 猿人菌 」第一时间阅读,思维导图,大数据书籍,大数据高频面试题,海量一线大厂面经…期待您的关注!**

|

||||

|

||||

|

||||

|

||||

517

note/实战项目/基于 flink 的电商用户行为数据分析【8】订单支付实时监控.md

Normal file

517

note/实战项目/基于 flink 的电商用户行为数据分析【8】订单支付实时监控.md

Normal file

@@ -0,0 +1,517 @@

|

||||

本篇是flink 的「电商用户行为数据分析」的第 8 篇文章,为大家带来的是**市场营销商业指标统计分析**之**订单支付实时监控**的内容!通过本期内容,我们可以实现通过使用**CEP**和**Process Function**来实现`订单支付实时监控`的功能,还能学会通过**connect** 和 **join**来实现`flink双流join`的功能,可谓干货满满!受益的朋友记得三连支持一下 ~

|

||||

|

||||

|

||||

***

|

||||

|

||||

## 订单支付实时监控

|

||||

在电商网站中,**订单的支付作为直接与营销收入挂钩的一环,在业务流程中非常重要**。对于订单而言,**为了正确控制业务流程,也为了增加用户的支付意愿,网站一般会设置一个支付失效时间,超过一段时间不支付的订单就会被取消**。另外,**对于订单的支付,我们还应保证用户支付的正确性,这可以通过第三方支付平台的交易数据来做一个实时对账**。在接下来的内容中,我们将实现这两个需求。

|

||||

|

||||

|

||||

## 模块创建和数据准备

|

||||

同样地,在UserBehaviorAnalysis下新建一个 maven module作为子项目,命名为`OrderTimeoutDetect`。在这个子模块中,我们同样将会用到 **flink** 的 **CEP** 库来实现事件流的模式匹配,所以需要在pom文件中引入CEP的相关依赖:

|

||||

|

||||

```xml

|

||||

<dependency>

|

||||

<groupId>org.apache.flink</groupId>

|

||||

<artifactId>flink-cep-scala_${scala.binary.version}</artifactId>

|

||||

<version>${flink.version}</version>

|

||||

</dependency>

|

||||

```

|

||||

|

||||

同样,在src/main/目录下,将默认源文件目录java改名为scala。

|

||||

|

||||

|

||||

## 代码实现

|

||||

在电商平台中,**最终创造收入和利润的是用户下单购买的环节**;更具体一点,是用户真正完成支付动作的时候。**用户下单的行为可以表明用户对商品的需求,但在现实中,并不是每次下单都会被用户立刻支付**。**当拖延一段时间后,用户支付的意愿会降低。所以为了让用户更有紧迫感从而提高支付转化率,同时也为了防范订单支付环节的安全风险,电商网站往往会对订单状态进行监控,设置一个失效时间(比如15分钟),如果下单后一段时间仍未支付,订单就会被取消**。

|

||||

|

||||

|

||||

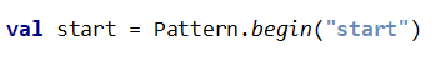

### 使用CEP实现

|

||||

|

||||

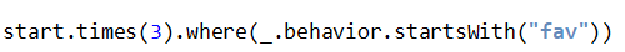

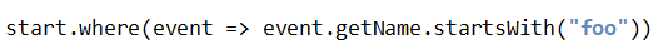

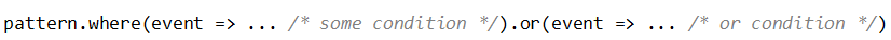

我们首先还是利用**CEP**库来实现这个功能。我们先将事件流按照订单号**orderId**分流,然后定义这样的一个**事件模式**:在15分钟内,事件“create”与“pay”非严格紧邻:

|

||||

|

||||

```scala

|

||||

// 1、 定义一个匹配事件序列的模式

|

||||

val orderPayPattern = Pattern

|

||||

.begin[OrderEvent]("create").where(_.eventType == "create") // 首先是订单的 create 事件

|

||||

.followedBy("pay").where(_.eventType == "pay") // 后面来的是订单的 pay 事件

|

||||

.within(Time.minutes(15)) // 间隔 15 分钟

|

||||

```

|

||||

这样调用.select方法时,就可以同时获取**到匹配出的事件**和**超时未匹配的事件**了。

|

||||

|

||||

在src/main/scala下继续创建`OrderTimeout.scala`文件,新建一个单例对象。定义样例类**OrderEvent**,这是输入的订单事件流;另外还有**OrderResult**,这是输出显示的订单状态结果。订单数据也本应该从UserBehavior日志里提取,由于`UserBehavior.csv`中没有做相关埋点,我们从另一个文件`OrderLog.csv`中读取登录数据。

|

||||

|

||||

|

||||

**完整代码如下:**

|

||||

|

||||

```scala

|

||||

import java.util

|

||||

|

||||

import org.apache.flink.cep.scala.pattern.Pattern

|

||||

import org.apache.flink.cep.scala.{CEP, PatternStream}

|

||||

import org.apache.flink.cep.{PatternSelectFunction, PatternTimeoutFunction}

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.timestamps.BoundedOutOfOrdernessTimestampExtractor

|

||||

import org.apache.flink.streaming.api.scala.{StreamExecutionEnvironment, _}

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/13 15:46

|

||||

* @Description:

|

||||

|

||||

*/

|

||||

object OrderTimeoutWithOutCep {

|

||||

|

||||

// 定义输入的订单事件样例类

|

||||

case class OrderEvent(orderId:Long,eventType:String,eventTime:Long)

|

||||

// 定义输出的订单检测结果样例类

|

||||

case class OrderResult(orderId:Long,resultMsg:String)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

|

||||

// 定义流处理环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置程序并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

// 从文件中读取数据,并转换成样例类

|

||||

val orderEventStream: DataStream[OrderEvent] = env.readTextFile("YOUR_PATH\\OrderLog.csv")

|

||||

.map(data => {

|

||||

// 样例数据: 34729,pay,sd76f87d6,1558430844

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

OrderEvent(dataArray(0).toLong, dataArray(1), dataArray(3).toLong)

|

||||

}) // 处理数据

|

||||

.assignTimestampsAndWatermarks(new BoundedOutOfOrdernessTimestampExtractor[OrderEvent](Time.seconds(3)) {

|

||||

override def extractTimestamp(element: OrderEvent): Long = element.eventTime * 1000L

|

||||

}) // 设置时间戳

|

||||

|

||||

// 1、 定义一个匹配事件序列的模式

|

||||

val orderPayPattern = Pattern

|

||||

.begin[OrderEvent]("create").where(_.eventType == "create") // 首先是订单的 create 事件

|

||||

.followedBy("pay").where(_.eventType == "pay") // 后面来的是订单的 pay 事件

|

||||

.within(Time.minutes(15)) // 间隔 15 分钟

|

||||

|

||||

// 2、 将 pattern 应用在按照 orderId分组的数据流上

|

||||

val patterStream: PatternStream[OrderEvent] = CEP.pattern(orderEventStream.keyBy(_.orderId), orderPayPattern)

|

||||

|

||||

// 3、定义一个侧输出流标签,用来标明超时事件的侧输出流

|

||||

val orderTimeOutputTag: OutputTag[OrderResult] = new OutputTag[OrderResult]("order time out")

|

||||

|

||||

// 4、调用select方法,提取匹配事件和超时事件,分别进行处理转换输出

|

||||

val result: DataStream[OrderResult] = patterStream

|

||||

.select(orderTimeOutputTag, new OrderTimeOutSelect(), new OrderPaySelect())

|

||||

|

||||

// 5、打印输出

|

||||

result.print("payed")

|

||||

result.getSideOutput(orderTimeOutputTag).print("timeout")

|

||||

|

||||

// 执行程序

|

||||

env.execute("order timeout detect job")

|

||||

|

||||

}

|

||||

|

||||

// 自定义超时处理函数

|

||||

class OrderTimeOutSelect() extends PatternTimeoutFunction[OrderEvent,OrderResult]{

|

||||

override def timeout(pattern: util.Map[String, util.List[OrderEvent]], timeoutTimestamp: Long): OrderResult = {

|

||||

val timeOutOrderId: Long = pattern.get("create").iterator().next().orderId

|

||||

OrderResult(timeOutOrderId,"timeout at" + timeoutTimestamp)

|

||||

}

|

||||

}

|

||||

|

||||

// 自定义匹配处理函数

|

||||

class OrderPaySelect() extends PatternSelectFunction[OrderEvent,OrderResult]{

|

||||

override def select(pattern: util.Map[String, util.List[OrderEvent]]): OrderResult = {

|

||||

|

||||

val payedOrderId: Long = pattern.get("pay").get(0).orderId

|

||||

OrderResult(payedOrderId,"pay successfully")

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

```

|

||||

|

||||

**运行结果:**

|

||||

|

||||

|

||||

### 使用Process Function实现

|

||||

我们同样可以利用Process Function,自定义实现检测订单超时的功能。为了简化问题,我们只考虑超时报警的情形,在pay事件超时未发生的情况下,输出超时报警信息。

|

||||

|

||||

一个简单的思路是,可以在订单的 create 事件到来后注册定时器,15分钟后触发;然后再用一个布尔类型的Value状态来作为标识位,表明pay事件是否发生过。如果pay事件已经发生,状态被置为true,那么就不再需要做什么操作;而如果pay事件一直没来,状态一直为false,到定时器触发时,就应该输出超时报警信息。

|

||||

|

||||

具体代码实现如下:

|

||||

|

||||

```scala

|

||||

import org.apache.flink.api.common.state.{ValueState, ValueStateDescriptor}

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.KeyedProcessFunction

|

||||

import org.apache.flink.streaming.api.functions.timestamps.BoundedOutOfOrdernessTimestampExtractor

|

||||

import org.apache.flink.streaming.api.scala._

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.util.Collector

|

||||

|

||||

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/23 19:35

|

||||

* @Description:

|

||||

|

||||

*/

|

||||

object OrderTimeout {

|

||||

|

||||

// 定义输入的订单事件样例类

|

||||

case class OrderEvent(orderId: Long, eventType: String, eventTime: Long)

|

||||

|

||||

// 定义输出的订单检测结果样例类

|

||||

case class OrderResult(orderId: Long, resultMsg: String)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

// 定义流处理环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置程序并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

// 读取输入的订单数据流

|

||||

val orderEventStream: DataStream[OrderEvent] = env.readTextFile("YOUR_PATH\\OrderLog.csv")

|

||||

.map(data => {

|

||||

// 示例数据: 34729,pay,sd76f87d6,1558430844

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

OrderEvent(dataArray(0).toLong, dataArray(1), dataArray(3).toLong)

|

||||

})

|

||||

// 设置水印

|

||||

.assignTimestampsAndWatermarks(new BoundedOutOfOrdernessTimestampExtractor[OrderEvent](Time.seconds(3)) {

|

||||

override def extractTimestamp(element: OrderEvent): Long = element.eventTime * 1000L

|

||||

})

|

||||

|

||||

// 自定义 Process Function,做精细化的流程控制

|

||||

val orderResultStream: DataStream[OrderResult] = orderEventStream

|

||||

.keyBy(_.orderId)

|

||||

.process(new OrderPayMatchDetect())

|

||||

|

||||

// 打印输出

|

||||

orderResultStream.print("payed")

|

||||

orderResultStream.getSideOutput(new OutputTag[OrderResult]("timeout")).print("timeout")

|

||||

|

||||

// 执行程序

|

||||

env.execute("order timeout without cep job")

|

||||

}

|

||||

|

||||

class OrderPayMatchDetect() extends KeyedProcessFunction[Long,OrderEvent,OrderResult]{

|

||||

// 定义状态,用来保存是否来过 create 和 pay 事件的标识位,以及定时器的时间戳

|

||||

lazy val isPayState:ValueState[Boolean] = getRuntimeContext.getState(new ValueStateDescriptor[Boolean]("is-payed", classOf[Boolean]))

|

||||

lazy val isCreateState:ValueState[Boolean] = getRuntimeContext.getState(new ValueStateDescriptor[Boolean]("is-created", classOf[Boolean]))

|

||||

|

||||

// 定义一个状态,保存每次定时器的时间戳

|

||||

lazy val timerTsState:ValueState[Long] = getRuntimeContext.getState(new ValueStateDescriptor[Long]("timer-ts", classOf[Long]))

|

||||

|

||||

// 定义一个侧输出流

|

||||

val orderTimeOutputTag = new OutputTag[OrderResult]("timeout")

|

||||

|

||||

override def processElement(value: OrderEvent, ctx: KeyedProcessFunction[Long, OrderEvent, OrderResult]#Context, out: Collector[OrderResult]): Unit = {

|

||||

|

||||

// 取出当前的状态

|

||||

val isPayed: Boolean = isPayState.value()

|

||||

val isCreated: Boolean = isCreateState.value()

|

||||

val timeTs: Long = timerTsState.value()

|

||||

|

||||

// 判断当前事件的类型,分成不同的情况讨论:

|

||||

// 情况1: 来的是 create,要继续判断之前是否有 pay 来过

|

||||

if (value.eventType == "create"){

|

||||

// 情况 1.1 : 如果已经pay过,匹配成功,输出到主流,清空状态

|

||||

if (isPayed){

|

||||

out.collect(OrderResult(value.orderId,"payed successfully"))

|

||||

// 清除状态

|

||||

isPayState.clear()

|

||||

timerTsState.clear()

|

||||

// 删除定时器

|

||||

ctx.timerService().deleteEventTimeTimer(timeTs)

|

||||

}

|

||||

// 情况 1.2:如果没有pay过,那么就注册一个15分钟后的定时器,开始等待

|

||||

else{

|

||||

val ts: Long = value.eventTime * 1000L + 15 * 60 *1000L

|

||||

// 设置一个15分钟的定时器

|

||||

ctx.timerService().registerEventTimeTimer(ts)

|

||||

|

||||

timerTsState.update(ts)

|

||||

isCreateState.update(true)

|

||||

}

|

||||

}

|

||||

|

||||

// 情况2:来的是pay,要继续判断是否来过 create

|

||||

else if (value.eventType == "pay"){

|

||||

// 情况2.1 : 如果 create 已经来过,匹配成功,要继续判断间隔时间是否超过了15分钟

|

||||

if (isCreated){

|

||||

// 情况 2.1.1:如果没有超时,正常输出结果到主流

|

||||

if (value.eventTime * 1000L < timeTs){

|

||||

out.collect(OrderResult(value.orderId,"payed successfully"))

|

||||

}else{

|

||||

// 情况2.1.2: 如果已经超时,那么输出 timeout 报警到侧输出流

|

||||

ctx.output(orderTimeOutputTag,OrderResult(value.orderId,"payed but already timeout"))

|

||||

}

|

||||

// 无论哪种情况,都已经有了输出,清空状态

|

||||

isCreateState.clear()

|

||||

timerTsState.clear()

|

||||

ctx.timerService().deleteEventTimeTimer(timeTs)

|

||||

}

|

||||

// 情况2.2 :如果 create 没来,需要等待乱序 create,注册一个当前pay时间戳的定时器

|

||||

else{

|

||||

val ts: Long = value.eventTime * 1000L

|

||||

// 设置定时器

|

||||

ctx.timerService().registerEventTimeTimer(ts)

|

||||

// 更新状态

|

||||

timerTsState.update(ts)

|

||||

isPayState.update(true)

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

override def onTimer(timestamp: Long, ctx: KeyedProcessFunction[Long, OrderEvent, OrderResult]#OnTimerContext, out: Collector[OrderResult]): Unit = {

|

||||

// 定时器触发,需要判断是哪种情况

|

||||

if (isPayState.value()){

|

||||

// 如果 pay 过,那么说明 create没来,可能出现了数据丢失异常的情况

|

||||

ctx.output(orderTimeOutputTag,OrderResult(ctx.getCurrentKey,"already payed but not found created log"))

|

||||

}else{

|

||||

// 如果 没有 pay过,那么说明真正 15 分钟 超时 [提交了订单,但是超过了15分钟仍未支付]

|

||||

ctx.output(orderTimeOutputTag,OrderResult(ctx.getCurrentKey,"order timeout"))

|

||||

}

|

||||

|

||||

// 清空状态

|

||||

isPayState.clear()

|

||||

isCreateState.clear()

|

||||

timerTsState.clear()

|

||||

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

```

|

||||

|

||||

**运行结果:**

|

||||

|

||||

|

||||

|

||||

|

||||

## 来自两条流的订单交易匹配

|

||||

对于订单支付事件,用户支付完成其实并不算完,我们还得确认平台账户上是否到账了。而往往这会来自不同的日志信息,所以我们要同时读入两条流的数据来做合并处理。这里我们利用`connect`将两条流进行连接,然后用自定义的**CoProcessFunction**进行处理。

|

||||

|

||||

具体代码如下:

|

||||

|

||||

```scala

|

||||

import org.apache.flink.api.common.state.{ValueState, ValueStateDescriptor}

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.co.CoProcessFunction

|

||||

import org.apache.flink.streaming.api.functions.timestamps.BoundedOutOfOrdernessTimestampExtractor

|

||||

import org.apache.flink.streaming.api.scala._

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.util.Collector

|

||||

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/13 15:57

|

||||

* @Description:

|

||||

来自两条流的订单交易匹配 ( connect 实现 )

|

||||

*/

|

||||

object OrderPayTxMatch {

|

||||

|

||||

// 输入输出的样例类

|

||||

case class ReceiptEvent(txId:String, payChannel:String, timestamp:Long)

|

||||

case class OrderEvent(orderId:Long, eventType:String, txId:String, eventTime:Long)

|

||||

|

||||

def main(args: Array[String]): Unit = {

|

||||

// 创建流处理的环境

|

||||

val env: StreamExecutionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment

|

||||

// 设置程序并行度

|

||||

env.setParallelism(1)

|

||||

// 设置时间特征为事件时间

|

||||

env.setStreamTimeCharacteristic(TimeCharacteristic.EventTime)

|

||||

|

||||

// 从 OrderLog.csv 文件中读取数据 ,并转换成样例类

|

||||

val orderEventStream: KeyedStream[OrderEvent, String] = env.readTextFile("G:\\idea arc\\BIGDATA\\project\\src\\main\\resources\\OrderLog.csv")

|

||||

.map(data => {

|

||||

// 样例数据 : 34731,pay,35jue34we,1558430849

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

OrderEvent(dataArray(0).toLong,dataArray(1),dataArray(2),dataArray(3).toLong)

|

||||

})

|

||||

.assignTimestampsAndWatermarks(new BoundedOutOfOrdernessTimestampExtractor[OrderEvent](Time.seconds(3)) {

|

||||

override def extractTimestamp(element: OrderEvent): Long = element.eventTime * 1000L

|

||||

}) // 为数据流中的元素分配时间戳

|

||||

.filter(_.eventType != "") // 只过滤出pay事件

|

||||

.keyBy(_.txId) // 根据 订单id 分组

|

||||

|

||||

// 从 ReceiptLog.csv 文件中读取数据 ,并转换成样例类

|

||||

val receiptStream: KeyedStream[ReceiptEvent, String] = env.readTextFile("YOUR_PATH\\ReceiptLog.csv")

|

||||

.map(data => {

|

||||

// 样例数据: 3hu3k2432,alipay,1558430848

|

||||

val dataArray: Array[String] = data.split(",")

|

||||

ReceiptEvent(dataArray(0), dataArray(1), dataArray(2).toLong)

|

||||

})

|

||||

.assignAscendingTimestamps(_.timestamp * 1000L) // 设置水印

|

||||

.keyBy(_.txId) // 根据 txId 进行分组

|

||||

|

||||

// connect 连接两条流,匹配事件进行处理

|

||||

val resultStream: DataStream[(OrderEvent, ReceiptEvent)] = orderEventStream.connect(receiptStream)

|

||||

.process(new OrderPayTxDetect())

|

||||

|

||||

// 定义侧输出流

|

||||

val unmatchedPays: OutputTag[OrderEvent] = new OutputTag[OrderEvent]("unmatched-pays")

|

||||

val unmatchedReceipts: OutputTag[ReceiptEvent] = new OutputTag[ReceiptEvent]("unmatched-receipts")

|

||||

|

||||

// 打印输出

|

||||

resultStream.print("matched")

|

||||

resultStream.getSideOutput(unmatchedPays).print("unmatched-pays")

|

||||

resultStream.getSideOutput(unmatchedReceipts).print("unmatched-receipts")

|

||||

env.execute("order pay tx match job")

|

||||

|

||||

}

|

||||

|

||||

// 定义 CoProcessFunction,实现两条流数据的匹配检测

|

||||

class OrderPayTxDetect() extends CoProcessFunction[OrderEvent,ReceiptEvent,(OrderEvent,ReceiptEvent)]{

|

||||

|

||||

// 定义两个 ValueState,保存当前交易对应的支付事件和到账事件

|

||||

lazy val payState: ValueState[OrderEvent] = getRuntimeContext.getState(new ValueStateDescriptor[OrderEvent]("pay", classOf[OrderEvent]))

|

||||

lazy val receiptState: ValueState[ReceiptEvent] = getRuntimeContext.getState(new ValueStateDescriptor[ReceiptEvent]("receipt", classOf[ReceiptEvent]))

|

||||

|

||||

//定义侧输出流

|

||||

val unmatchedPays: OutputTag[OrderEvent] = new OutputTag[OrderEvent]("unmatched-pays")

|

||||

val unmatchedReceipts: OutputTag[ReceiptEvent] = new OutputTag[ReceiptEvent]("unmatched-receipts")

|

||||

|

||||

override def processElement1(pay: OrderEvent, ctx: CoProcessFunction[OrderEvent, ReceiptEvent, (OrderEvent, ReceiptEvent)]#Context, out: Collector[(OrderEvent, ReceiptEvent)]): Unit = {

|

||||

// pay 来了,考察有没有对应的 receipt 来过

|

||||

val receipt: ReceiptEvent = receiptState.value()

|

||||

if (receipt != null){

|

||||

// 如果已经有 receipt,正常输出到主流

|

||||

out.collect((pay,receipt))

|

||||

receiptState.clear()

|

||||

}else{

|

||||

// 如果 receipt 还没来,那么把 pay 存入状态,注册一个定时器等待 5 秒

|

||||

payState.update(pay)

|

||||

ctx.timerService().registerEventTimeTimer(pay.eventTime * 1000L + 5000L)

|

||||

}

|

||||

}

|

||||

|

||||

override def processElement2(receipt: ReceiptEvent, ctx: CoProcessFunction[OrderEvent, ReceiptEvent, (OrderEvent, ReceiptEvent)]#Context, out: Collector[(OrderEvent, ReceiptEvent)]): Unit = {

|

||||

//receipt来了,考察有没有对应的pay来过

|

||||

val pay: OrderEvent = payState.value()

|

||||

if (pay != null) {

|

||||

//如果已经有pay,那么正常匹配,输出到主流

|

||||

out.collect((pay, receipt))

|

||||

payState.clear()

|

||||

}else{

|

||||

// 如果 pay 还没来,那么把 receipt 存入状态,注册一个定时器等待 3 秒

|

||||

receiptState.update(receipt)

|

||||

ctx.timerService().registerEventTimeTimer(receipt.timestamp * 1000L + 3000L)

|

||||

}

|

||||

}

|

||||

|

||||

// 定时触发, 有两种情况,所以要判断当前有没有pay和receipt

|

||||

override def onTimer(timestamp: Long, ctx: CoProcessFunction[OrderEvent, ReceiptEvent, (OrderEvent, ReceiptEvent)]

|

||||

#OnTimerContext, out: Collector[(OrderEvent, ReceiptEvent)]): Unit = {

|

||||

|

||||

//如果 pay 不为空,说明receipt没来,输出unmatchedPays

|

||||

if (payState.value() != null){

|

||||

ctx.output(unmatchedPays,payState.value())

|

||||

}

|

||||

|

||||

if (receiptState.value() != null){

|

||||

ctx.output(unmatchedReceipts,receiptState.value())

|

||||

}

|

||||

|

||||

// 清除状态

|

||||

payState.clear()

|

||||

receiptState.clear()

|

||||

}

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

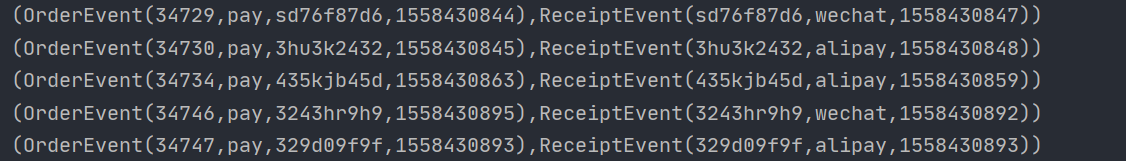

**运行结果:**

|

||||

|

||||

对于flink的双流join通过`connect`的做法,肯定会有小伙伴觉得过程比较冗复杂,那还有没有其他的方法也能实现类似的效果呢?

|

||||

|

||||

当然是有的,下面就为大家展示另一种通过`intervalJoin`方法实现的方式:

|

||||

|

||||

```scala

|

||||

import org.apache.flink.streaming.api.TimeCharacteristic

|

||||

import org.apache.flink.streaming.api.functions.co.ProcessJoinFunction

|

||||

import org.apache.flink.streaming.api.functions.timestamps.BoundedOutOfOrdernessTimestampExtractor

|

||||

import org.apache.flink.streaming.api.scala._

|

||||

import org.apache.flink.streaming.api.windowing.time.Time

|

||||

import org.apache.flink.util.Collector

|

||||

|

||||

/*

|

||||

* @Author: Alice菌

|

||||

* @Date: 2020/12/12 20:23

|

||||

* @Description:

|

||||

来自两条流的订单交易匹配 ( JOIN 实现 )

|

||||

*/

|

||||